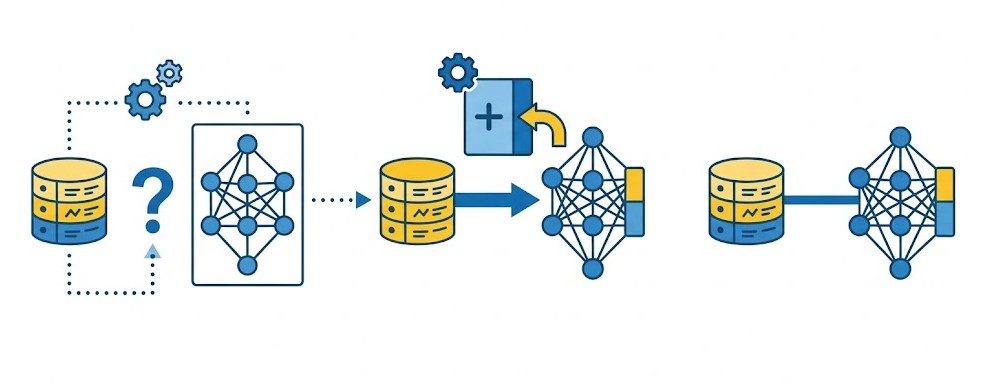

Les paramètres essentiels pour l'action addLayer sont :

layer: Ce paramètre, obligatoire, définit le type spécifique de la couche à ajouter (par exemple,BATCHNORM,CONVOLUTION,FULLCONNECT,INPUT,OUTPUT,POOLING,RECURRENT) ainsi que toutes ses configurations spécifiques (dimensions, fonctions d'activation, etc.).modelTable: Ce paramètre, également obligatoire, identifie la table en mémoireGemini said

Espace de stockage temporaire (RAM) utilisé par le moteur CAS pour charger et traiter les données à haute vitesse, minimisant les accès disque pour optimiser les performances de SAS Viya. qui contient le modèleReprésentation mathématique entraînée sur des données pour capturer des tendances, prédire des résultats ou classifier des observations via des algorithmes (Régression, Forêt aléatoire, Gradient Boosting). de Deep LearningSous-ensemble du Machine Learning basé sur des réseaux de neurones artificiels profonds. Il excelle dans l'extraction automatique de motifs complexes depuis des données brutes (images, texte, son). existant auquel la nouvelle couche doit être ajoutée.name: Un nom unique qui sera attribué à la nouvelle couche. Ce nom est crucial pour référencer cette couche ultérieurement, notamment pour spécifier les couches sources (viasrcLayers) d'autres couches qui en dépendraient.