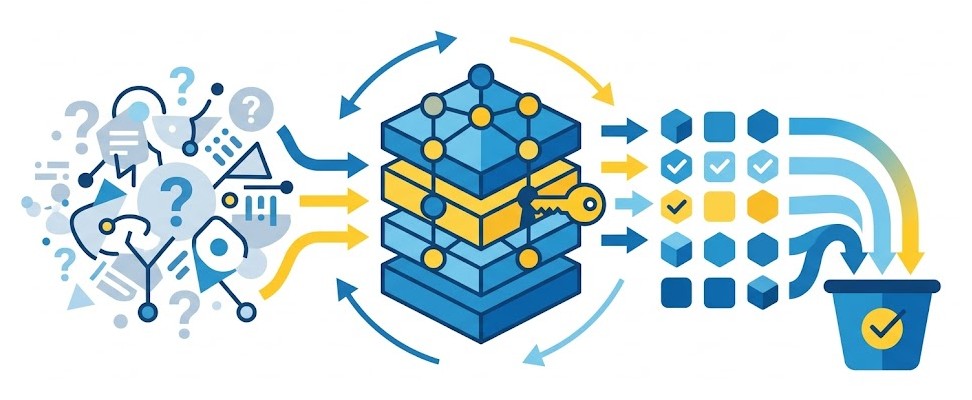

La tokenisation est une étape fondamentale et critique dans le flux de traitement du langage naturel (NLPTraitement automatique du langage naturel visant à permettre aux machines de comprendre, d'interpréter et de générer du texte ou de la parole de manière cohérente et structurée.). Par défaut, l'action utilise le paramètre tokenizer réglé sur la valeur STANDARD, qui déploie automatiquement un algorithme d'analyse lexicale spécifique à chaque langue couverte par votre licence (définie par le paramètre language). Cependant, pour répondre aux défis techniques liés à l'analyse syntaxique du chinois, du japonais ou du coréen, SAS Viya propose de définir ce paramètre sur BASIC. Cette option alternative segmente les documents en s'appuyant de manière pragmatique sur les espaces, les signes de ponctuation et les caractères spécifiques asiatiques, ce qui peut considérablement améliorer le déclenchement et la précision des règles linguistiques pour ces marchés.

Comment optimiser le traitement du langage naturel et l'analyse sémantique pour les textes en chinois, japonais ou coréen ?

Optimisation CJK via SAS Visual Text Analytics

Exemples pour l'action compileCategory

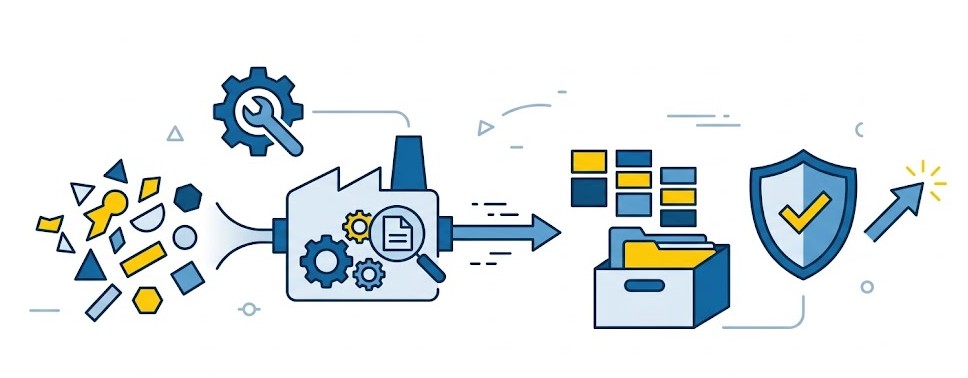

Compilation basique d'un modèle

On compile les règles présentes dans la variable 'rule_txt' de la table 'rules_in_cas' vers un fichier binaire 'cat_model'.

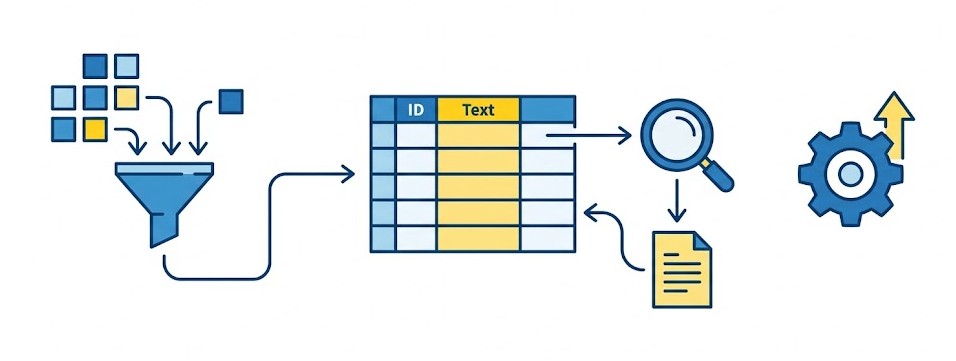

Compilation avec intégration de concepts et Tokenizer spécifique

Exemple avancé utilisant des concepts préalablement compilés et forçant le remplacement du modèle existant.