Afin de garantir la capacité de généralisation de votre modèleReprésentation mathématique entraînée sur des données pour capturer des tendances, prédire des résultats ou classifier des observations via des algorithmes (Régression, Forêt aléatoire, Gradient Boosting). de traitement du langage naturel, l'utilisation du bloc d'options validate est primordiale. Vous pouvez définir la fréquence de vérification via l'argument frequency (mesuré en époques) et instaurer une règle d'arrêt anticipé avec stagnation. Si le taux d'erreur sur votre échantillon de validation augmente consécutivement au-delà de ce seuil de stagnation, l'entraînement s'arrête automatiquement, vous protégeant ainsi contre le phénomène d'overfittingSurapprentissage d'un modèle mémorisant le bruit des données d'entraînement au lieu des tendances, réduisant ainsi sa capacité de généralisation et sa précision sur de nouvelles observations..

Comment maîtriser le surapprentissage de vos réseaux CRF grâce aux paramètres de validation intégrés ?

Maîtrise de la convergence avec crf.crfTrain

Exemples pour l'action crfTrain

Entraînement CRF basique

Découvrez cet exemple pour l'action CAS crfTrain : il initialise un apprentissage supervisé par champs aléatoires conditionnels via un fenêtrage local ([-1,0] à [1,0]) pour extraire les features.

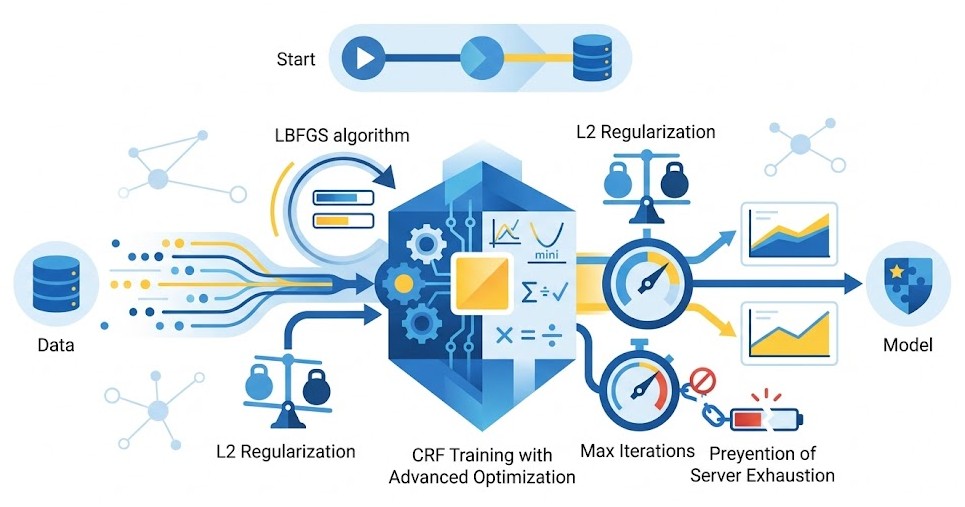

Entraînement CRF avec Optimisation Avancée

Découvrez cet exemple pour l'action CAS crfTrain : il optimise un modèle CRF via LBFGS avec régularisation L2 et contrôle de convergence (fConv), assurant une extraction d'entités stable et performante.