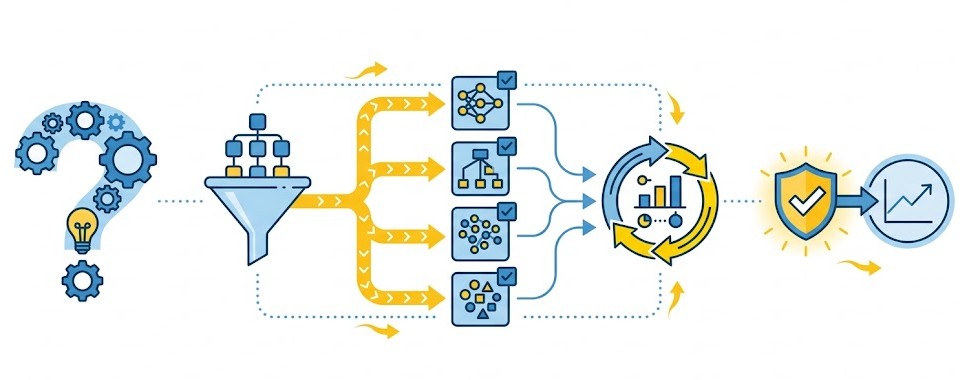

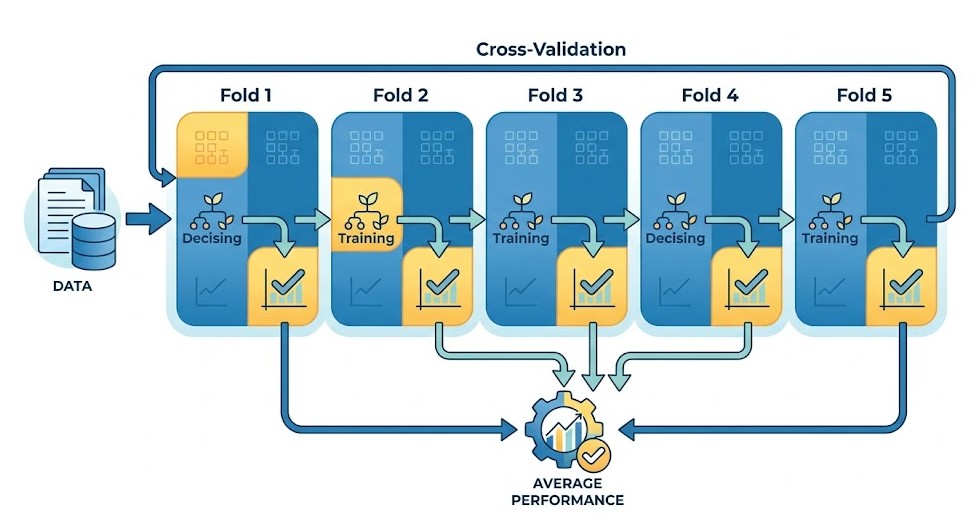

L'action crossValidate de l'ensemble d'actions mlTools est l'outil indispensable pour évaluer la capacité de généralisation de vos modèles. En divisant vos données en plusieurs segments, définis par le paramètre kFolds (avec un minimum de 2 et par défaut 5), cette action entraîne et valide itérativement le modèleReprésentation mathématique entraînée sur des données pour capturer des tendances, prédire des résultats ou classifier des observations via des algorithmes (Régression, Forêt aléatoire, Gradient Boosting). sur des sous-ensembles différents. Cela permet aux data scientistsExperts extrayant des connaissances via des méthodes statistiques, algorithmes et IA. Ils transforment les données brutes en insights stratégiques pour résoudre des problèmes métier complexes. et aux architectes de solutions de s'assurer que les performances mesurées ne sont pas un artefact lié à un échantillon d'apprentissage spécifique, garantissant ainsi des décisions métier fiables lors du déploiement en production.

Comment garantir la robustesse d un modele predictif sans risquer le surapprentissage sur de nouvelles donnees ?

Validation Croisée via mlTools

Exemples pour l'action crossValidate

Validation croisée basique d'un Arbre de Décision

Cet exemple évalue la robustesse d'un arbre de décision via $k$-fold validation. Il automatise le partitionnement, l'entraînement et l'agrégation des métriques pour mesurer l'erreur de généralisation.

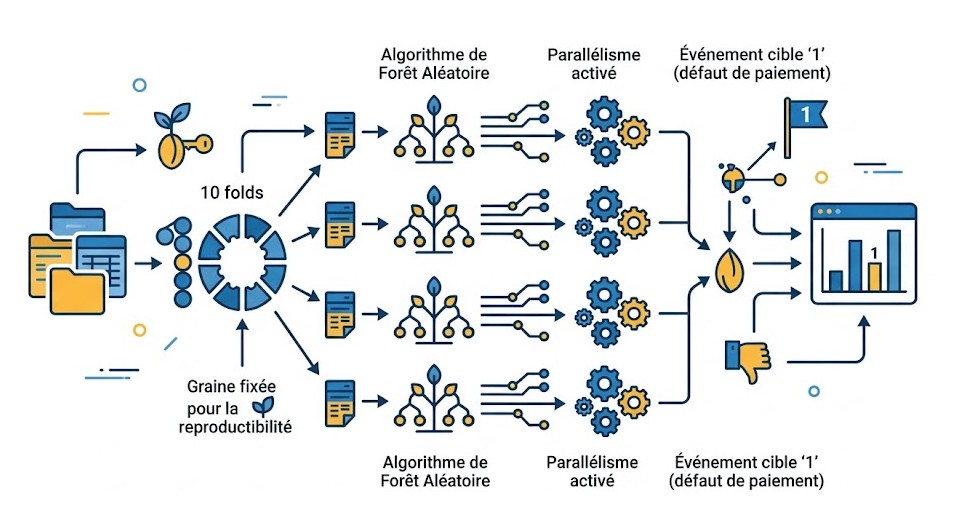

Validation croisée robuste d'une Forêt Aléatoire

Cet exemple optimise l'action crossValidate en parallélisant 10 plis (K-folds) sur un modèle FOREST. Il assure la reproductibilité via seed et cible l'événement binaire pour évaluer la stabilité.