Le traitement de réseaux de neurones profonds sur de vastes volumes de données économiques nécessite une puissance de calcul colossale. L'action prend nativement en charge l'accélération matérielle via le bloc de paramètres gpu. En activant ce bloc, vous pouvez distribuer la charge sur des processeurs graphiques spécifiques avec le paramètre devices. L'optimisation majeure pour les environnements de production réside dans la gestion de la précision mathématique : utiliser FP16 au lieu de FP32 permet de solliciter directement les cœurs Tensor des architectures matérielles modernes, ce qui accélère drastiquement les itérations de calcul. De plus, l'activation de useTensorRT facilite une phase d'inférence foudroyante en s'appuyant sur les bibliothèquesPointeurs logiques (Libref) reliant SAS Viya à des sources de données physiques (dossiers, bases de données, CAS) pour lire, écrire et organiser les tables de manière structurée. bas niveau optimisées.

Comment optimiser les temps de calcul massifs de l'action deepprice grâce à l'accélération matérielle ?

Accélération GPU & Optimisation de Précision

Exemples pour l'action deepprice

Modélisation basique des prix

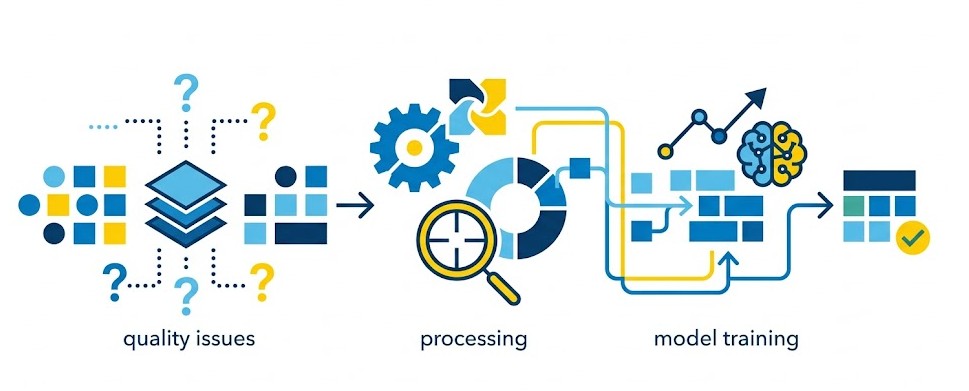

Estimation de l'élasticité avec des réseaux de neurones simples à deux couches (16 et 8 nœuds) pour les modèles de résultat et de traitement.

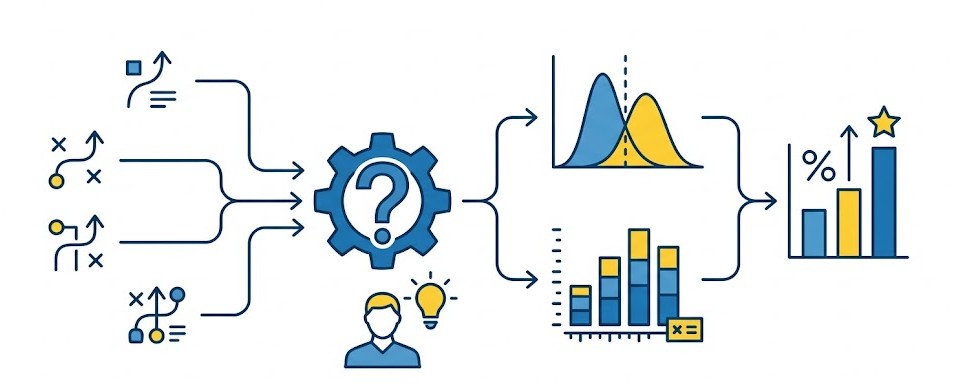

Analyse causale complète avec optimisation ADAM, Inférence et Scoring

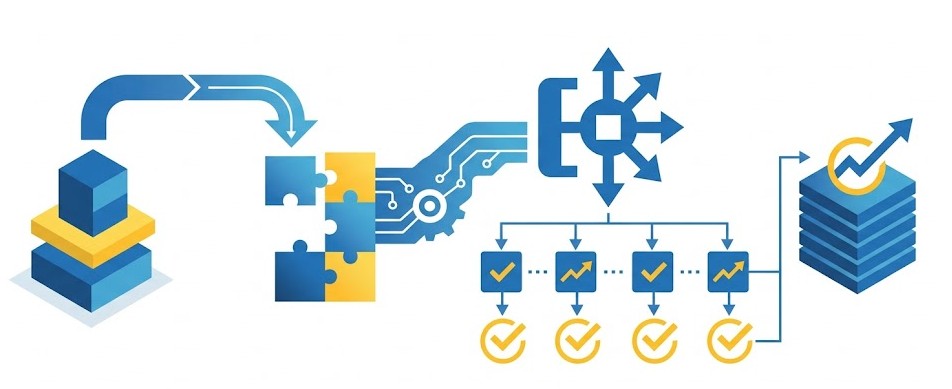

Configuration avancée de `deepprice` avec utilisation d'une variable instrumentale, des hyperparamètres d'entraînement personnalisés (ADAM, miniBatchSize), évaluation d'une politique, et sauvegarde exhaustive des tables de scores et d'inférence.