Après votre configuration HadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data., dans mon cas Hortonworks, vous pouvez être confronter au message d'erreur "hive is not allowed to impersonate hive" lorsque vous tentez d’accéder à votre clusterEnsemble de nœuds (machines) interconnectés, gérés par Kubernetes, qui collaborent pour exécuter les microservices et le moteur CAS de SAS Viya, assurant haute disponibilité et passage à l'échelle. :

Après votre configuration HadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data., dans mon cas Hortonworks, vous pouvez être confronter au message d'erreur "hive is not allowed to impersonate hive" lorsque vous tentez d’accéder à votre clusterEnsemble de nœuds (machines) interconnectés, gérés par Kubernetes, qui collaborent pour exécuter les microservices et le moteur CAS de SAS Viya, assurant haute disponibilité et passage à l'échelle. :

| Error: Failed to open new sessionInstance de connexion active entre un client et le serveur CAS (Cloud Analytic Services), isolant les ressources, les bibliothèques et les traitements d'un utilisateur au sein de SAS Viya.: java.lang.RuntimeException: java.lang.RuntimeException: org.apache.hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data..ipc.RemoteException(org.apache.hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data..security.authorize.AuthorizationException): User: hive is not allowed to impersonate hive (state=,code=0) |

1. Modification de la configuration

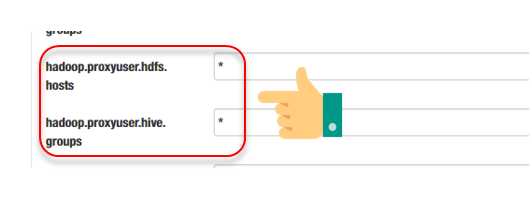

Dans le répertoire de configuration (/usr/hdp/2.3.6.0-3796/hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data./conf), modifiez le fichier core-site.xml : <property><name>hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data..proxyuser.hive.groups</name><value>*</value></property> <property><name>hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data..proxyuser.hive.hosts</name><value>*</value></property>2. Vérifier la prise en compte de la modification

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. org.apache.hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data..conf.Configuration |grep proxy | grep hive3. Relancer le namenode et le datanode

Arret/relance1

2

2

/usr/hdp/current/hadoop-client/sbin/hadoop-daemon.sh stop namenode

/usr/hdp/current/hadoop-client/sbin/hadoop-daemon.sh stop datanode

/usr/hdp/current/hadoop-client/sbin/hadoop-daemon.sh stop datanode

1

2

2

/usr/hdp/current/hadoop-client/sbin/hadoop-daemon.sh start namenode

/usr/hdp/current/hadoop-client/sbin/hadoop-daemon.sh start datanode

/usr/hdp/current/hadoop-client/sbin/hadoop-daemon.sh start datanode

4. Vérification HadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data.

1

hadoop dfsadmin -report

5. Vérification de la prise en compte

1

2

3

2

3

beeline

beeline> !connect jdbc:hive2://monserveur:10000

beeline> Enter username for jdbc:hive2://monserveur:10000:hive

beeline> !connect jdbc:hive2://monserveur:10000

beeline> Enter username for jdbc:hive2://monserveur:10000:hive

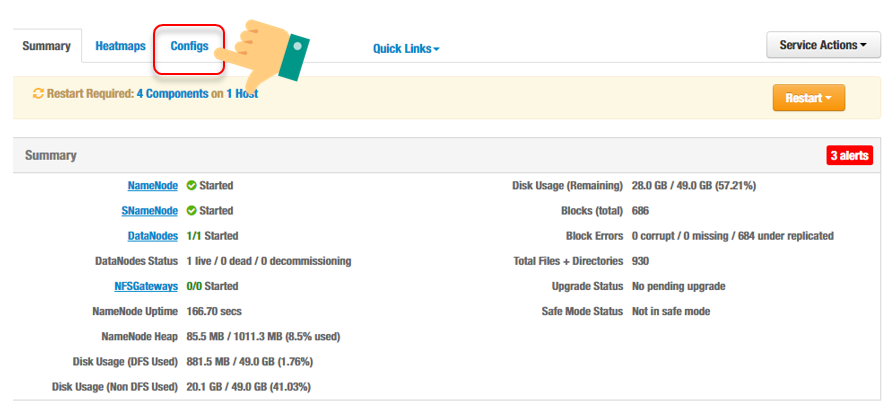

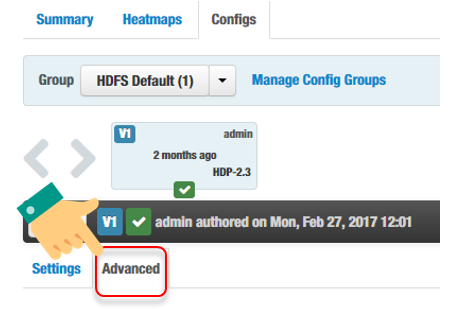

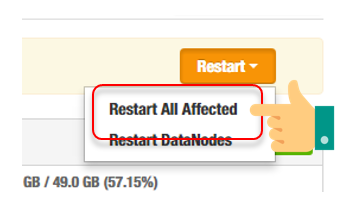

Effectuer la modification dans AMBARI