2

3

4

5

6

7

8

9

10

11

12

13

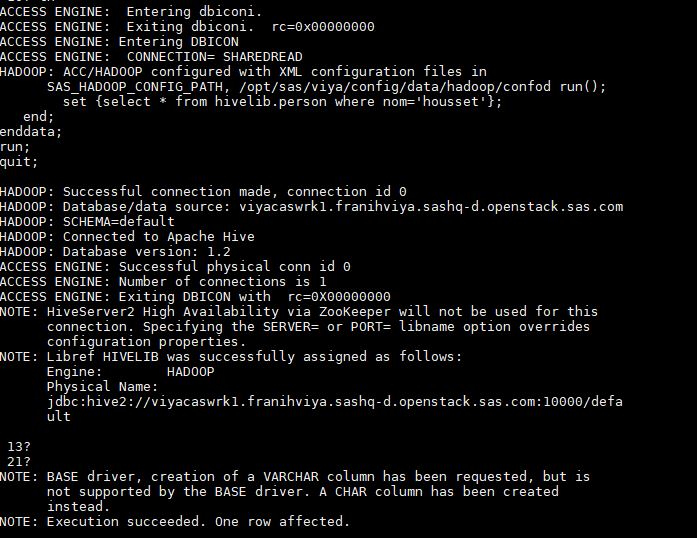

options set=SAS_HADOOP_JAR_PATH="/opt/sas/viya/config/data/hadoop/lib";

libname hivelib hadoop server='MON_SERVEUR_HIVE';

proc ds2;

data cars;

method run();

set {select * from hivelib.person where nom='housset'};

end;

enddata;

run;

quit;

Note :

Les options SAS_HADOOP_CONFIG_PATH et SAS_HADOOP_JAR_PATH permettent de définir la configuration HadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. et les jars HadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. nécessaires à la connexion à Hive.

Note :

Les options SAS_HADOOP_CONFIG_PATH et SAS_HADOOP_JAR_PATH permettent de définir la configuration HadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. et les jars HadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. nécessaires à la connexion à Hive.

![[VIDEO] Analysis of IMDb Reviews Using SAS Data Mining and Sentiment Analysis](/wp-content/uploads/2016/04/sas-global-forum-2016-imdb.jpg)