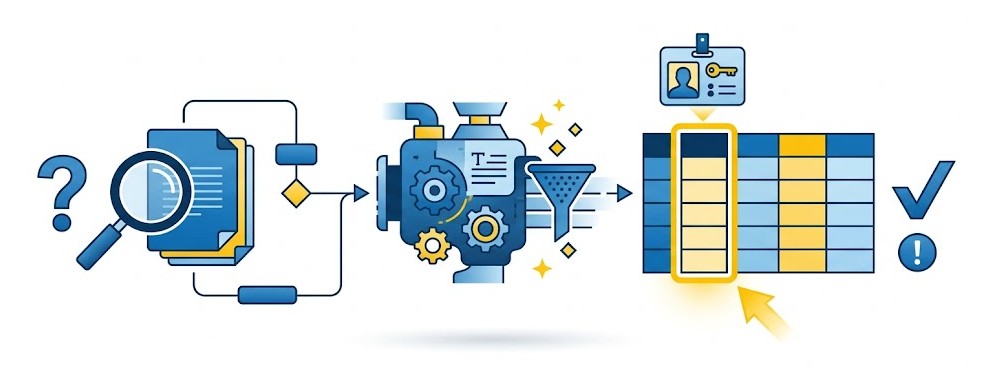

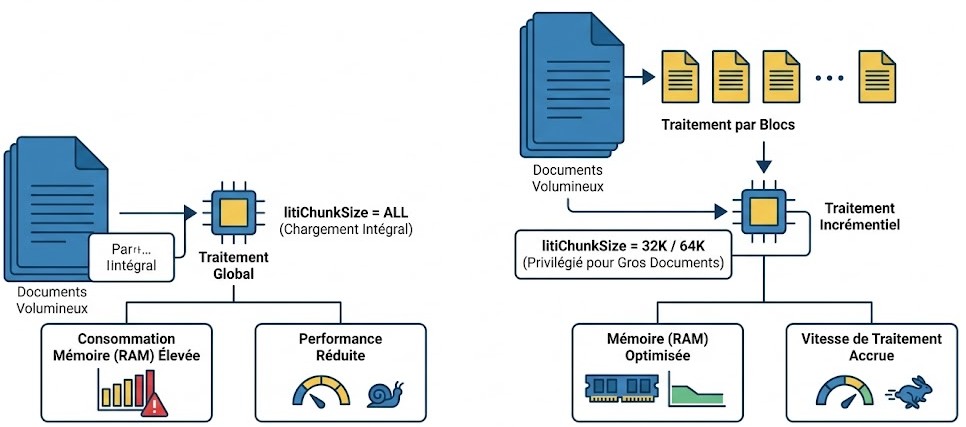

Le paramètre litiChunkSize détermine la taille des blocs utilisés pour le traitement d'un document. Par défaut, la taille de bloc est de "32K". Une valeur de ALL indique qu'aucun découpage n'est effectué et que l'intégralité du document est chargée et traitée en une seule fois. La taille peut être spécifiée en octets (B), kilooctets (K) ou mégaoctets (M). Des tailles de blocs plus petites (par exemple, 16K ou 32K) sont avantageuses pour le traitement de documents avec une mémoireGemini said

Espace de stockage temporaire (RAM) utilisé par le moteur CAS pour charger et traiter les données à haute vitesse, minimisant les accès disque pour optimiser les performances de SAS Viya. limitée ou pour un traitement incrémentiel. L'utilisation de ALL peut ne pas être optimale pour de très grands documents en raison d'une consommation mémoireGemini said

Espace de stockage temporaire (RAM) utilisé par le moteur CAS pour charger et traiter les données à haute vitesse, minimisant les accès disque pour optimiser les performances de SAS Viya. élevée et d'une performance réduite. Pour les documents volumineux, privilégiez des tailles de blocs plus petites, telles que 32K ou 64K, afin d'améliorer la vitesse de traitement et de réduire la consommation de mémoireGemini said

Espace de stockage temporaire (RAM) utilisé par le moteur CAS pour charger et traiter les données à haute vitesse, minimisant les accès disque pour optimiser les performances de SAS Viya..

Comment optimiser le traitement des documents volumineux via la taille des blocs (chunks) ?

Optimisation Mémoire : Le Paramètre litiChunkSize

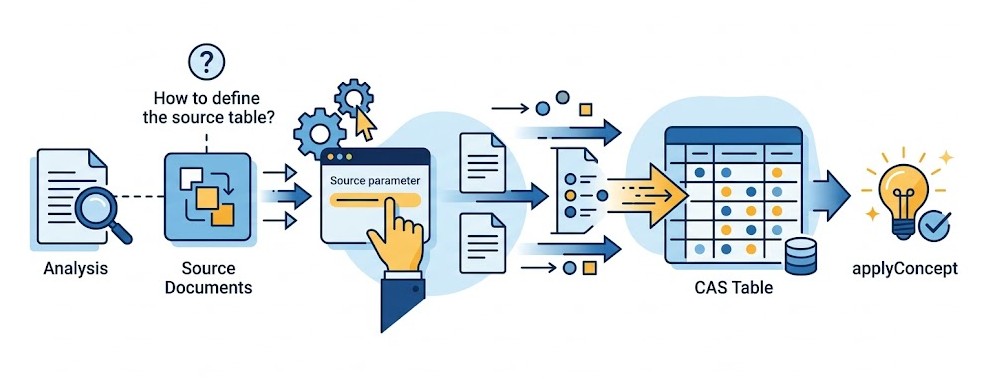

Exemples pour l'action applyConcept

Application du modèle de concept de base

Cet exemple illustre l'extraction d'entités via l'action applyConcept. Sans paramètre model, le moteur NLP déploie son modèle LISI natif pour isoler types d'entités et faits structurés.

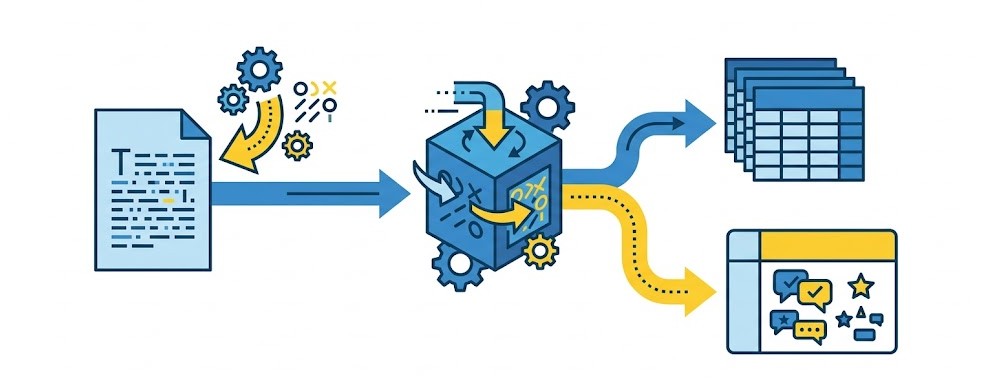

Extraction avancée avec filtrage de concepts et optimisation mémoire

Cet exemple optimise l'action applyConcept : segmentation par chunks de 16 Ko, filtrage sélectif via dropConcepts et traçabilité des règles avec ruleMatchOut pour un scoring haute précision.