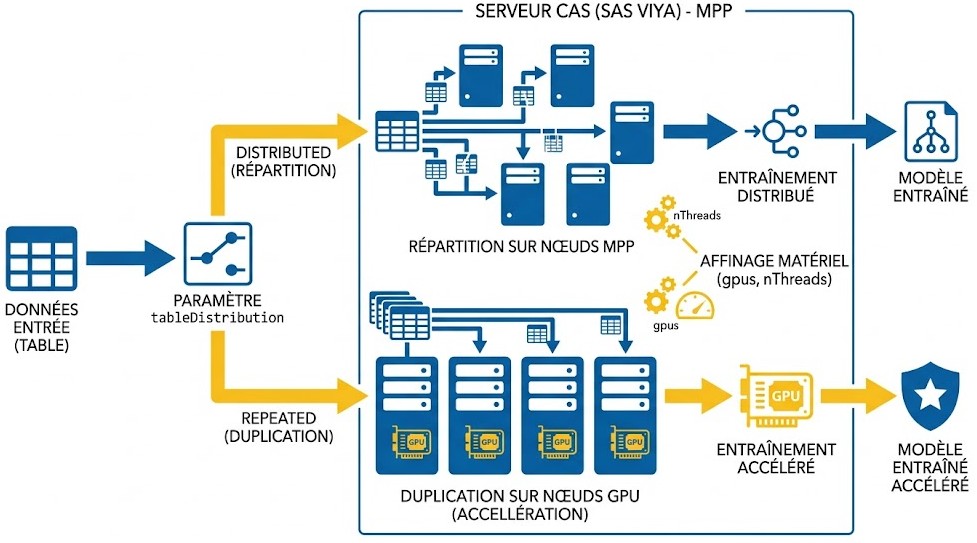

La gestion de la distribution se fait via le paramètre tableDistribution, qui détermine la répartition des données dans un environnement de traitement massivement parallèle. Vous pouvez opter pour DISTRIBUTED pour répartir les lignes de données sur les nœuds, ou REPEATED pour dupliquer les données, ce qui est souvent privilégié pour accélérer les calculs distribués sur de multiples cartes graphiques. Les paramètres gpus et nThreads permettent par la suite d'affiner l'utilisation des ressources matérielles du serveur Cloud Analytic ServicesMoteur d'exécution in-memory de SAS Viya. Il assure le traitement massivement parallèle (MPP) et distribué des données pour optimiser les performances analytiques et le passage à l'échelle..

Comment cette action gère-t-elle la distribution des données pour accélérer l'entraînement sur des architectures massivement parallèles ?

Optimisation de la distribution CAS et GPU

Exemples pour l'action dlmztrain

Entraînement basique d'un modèle de Deep Learning

Cet exemple montre comment lancer un entraînement simple avec l'optimiseur ADAM sur 5 époques à partir de données d'images.

Entraînement avancé avec Validation, accélération GPU et Arrêt Prématuré

Ici on sort l'artillerie lourde : utilisation de GPU multiples, d'un jeu de validation croisée, de l'optimiseur SGD avec momentum, et d'un mécanisme d'arrêt prématuré (Early Stopping) si la perte de validation stagne pendant 3 époques consécutives.