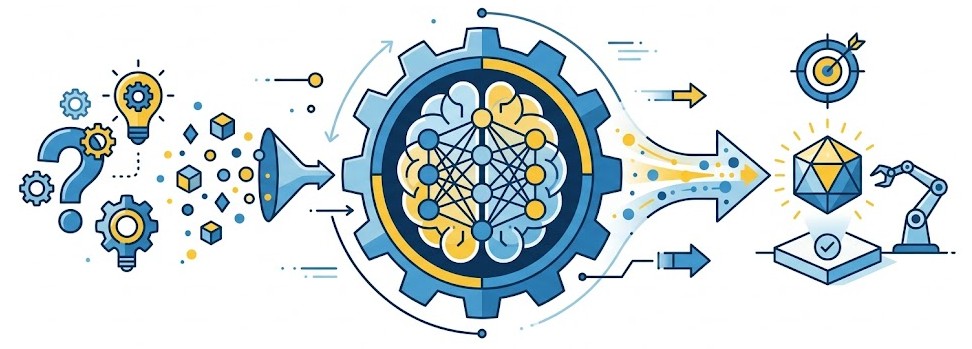

Oui, le Transfer Learning est géré très efficacement. En spécifiant une valeur numérique pour le paramètre freezeLayer et le type de couche via freezeLayerType, l'algorithme d'optimisation n'actualisera pas les poids des couches ciblées. Cela permet de conserver les caractéristiques extraites par un modèleReprésentation mathématique entraînée sur des données pour capturer des tendances, prédire des résultats ou classifier des observations via des algorithmes (Régression, Forêt aléatoire, Gradient Boosting). pré-entraîné complexe (fourni via le paramètre modelTable), tout en adaptant uniquement les couches finales à votre propre cible analytique configurée dans targets.

L'action supporte-t-elle le Transfer Learning ou le gel de couches pour affiner un modèle pré-entraîné à nos données spécifiques ?

Exemples pour l'action dlmztrain

Entraînement basique d'un modèle de Deep Learning

Cet exemple montre comment lancer un entraînement simple avec l'optimiseur ADAM sur 5 époques à partir de données d'images.

Entraînement avancé avec Validation, accélération GPU et Arrêt Prématuré

Ici on sort l'artillerie lourde : utilisation de GPU multiples, d'un jeu de validation croisée, de l'optimiseur SGD avec momentum, et d'un mécanisme d'arrêt prématuré (Early Stopping) si la perte de validation stagne pendant 3 époques consécutives.